type

Post

status

Published

date

Dec 5, 2022

slug

latent-diffusion-paper-notes

summary

总结 Latent Diffusion Models 论文的核心问题、方法设计、实验结果和局限性。

tags

知识

category

技术分享

icon

password

本文同步自 CSDN 文章。

Abstract1. Introduction不足之处提出问题解决方法:Departure to Latent Space(脱离并去往潜在空间)方法的优点ContributionsRelated WorkGenerative Models for Image SynthesisDiffusion Probabilistic Models (DM)Two-Stage Image SynthesisMethodPerceptual Image CompressionLatent Diffusion ModelsExperimentsImplementation DetailsConditional Latent DiffusionSuper-Resolution with Latent DiffusionLimitations & Societal ImpactConclusion

Abstract

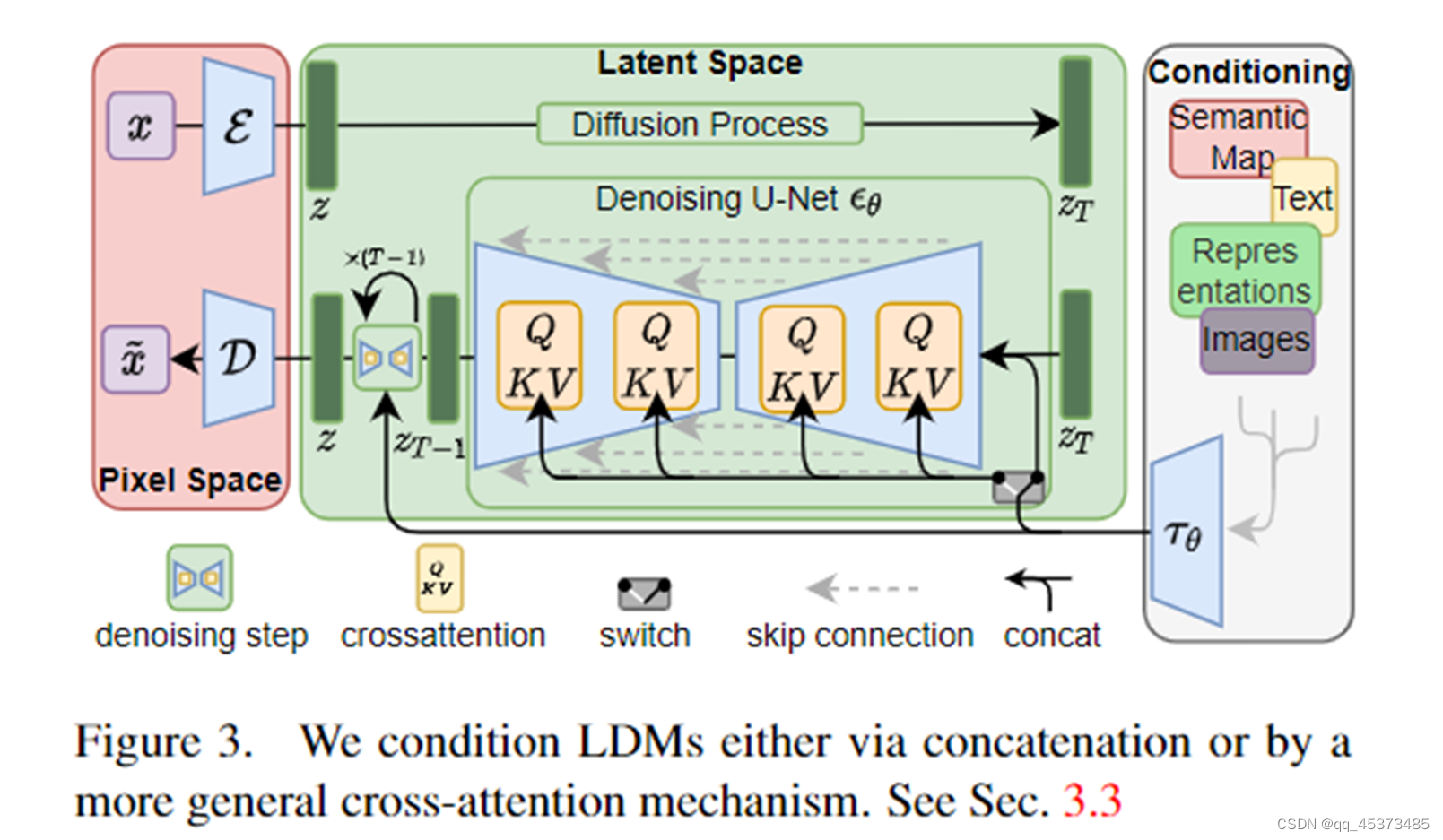

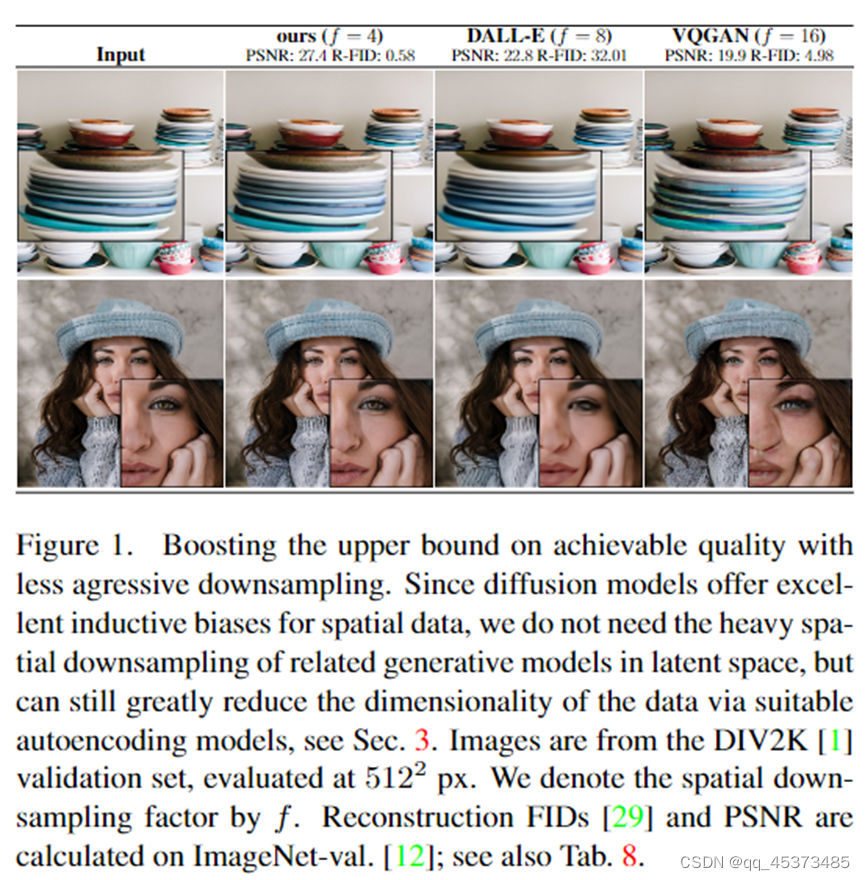

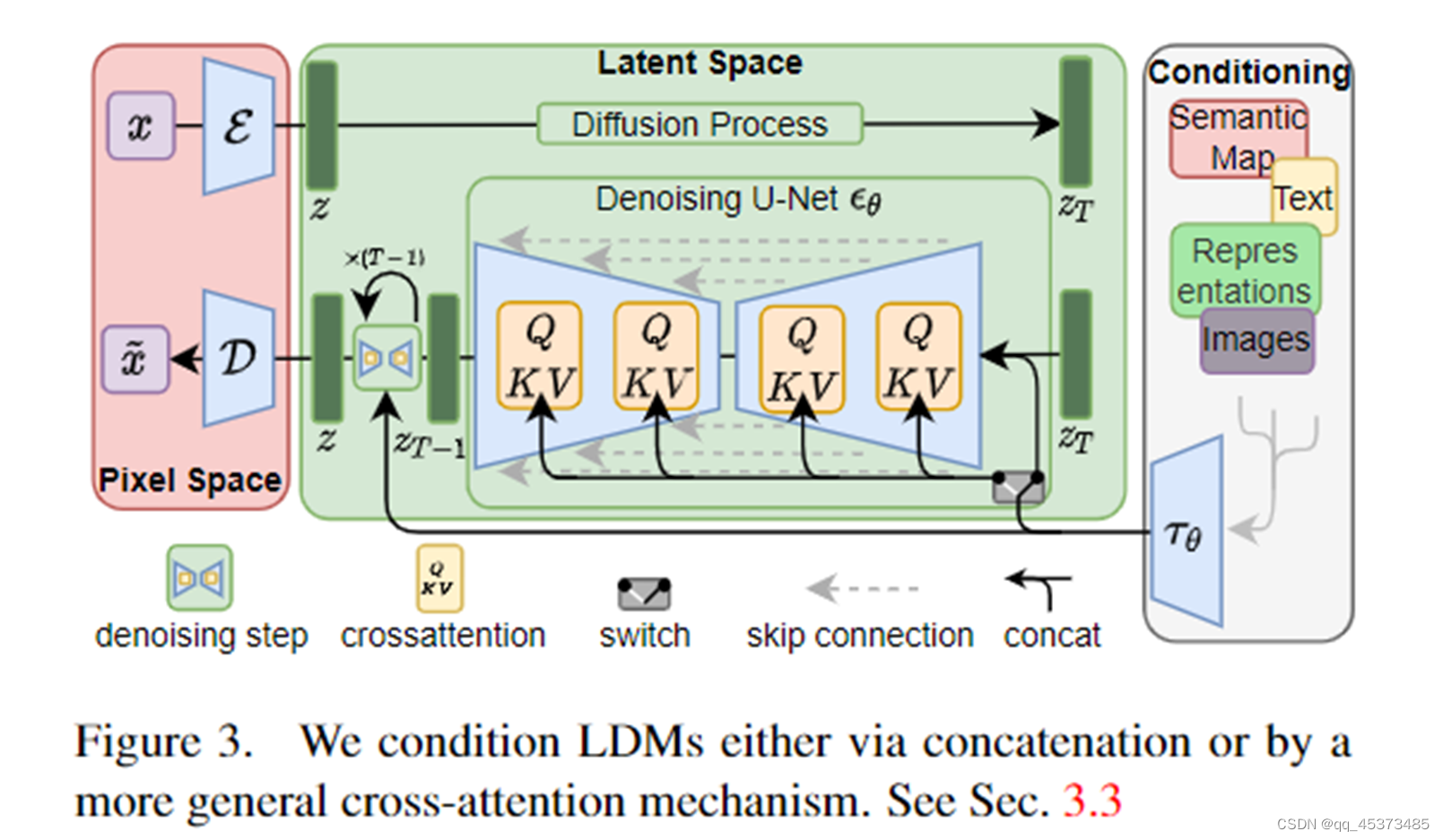

通过将图像生成过程分解为去噪编码器的迭代应用,扩散模型(DMs)在图像数据和其他数据上实现了最先进的合成结果。此外,它们的表述还提供了一种引导机制来控制图像生成过程,而无需再训练。然而,由于这些模型通常直接在像素空间中操作,优化功能强大的 dm 通常会消耗数百个 GPU 天,而且由于顺序计算,推理是昂贵的(耗时)。为了在有限的计算资源上进行 DM 训练,同时保持其质量和灵活性,我们将其应用于强大的预训练预编码的潜在空间。与以前的工作相比,在这种表示上训练扩散模型首次允许在复杂性减少和细节保留之间达到一个接近最优点,极大地提高了视觉保真度。通过在模型架构中引入交叉注意层,我们将扩散模型转变为强大而灵活的生成器,用于文本或边界框等一般条件反射输入,并以卷积方式实现高分辨率合成。我们的潜在扩散模型 (LDM) 在图像嵌入和类条件图像合成方面取得了最新的分数,在各种任务上具有极具竞争力的性能,包括文本到图像合成、无条件图像生成和超分辨率,同时与基于单像素的 DMs 相比显著减少了计算需求。

1. Introduction

- 自回归(AR)和 transformer 的数十亿个参数 [66,67],以及参数量巨大的 GAN [3,27,40]。

- 它们的对抗性学习过程不容易扩展到建模复杂的多模态,仅限于变异性相对有限的数据分布。

- 扩散模型 [82] 建立在去噪自动编码器的层次上,已经表明令人不可思议的成果。作为基于似然的模型,它们不像 GAN 那样表现出模式崩溃和训练不稳定性,并且通过大量利用参数共享,它们可以模拟自然图像的高度复杂分布,而不像 AR 模型那样涉及数十亿个参数 [67]。

不足之处

- 此前的高分辨率图像合成 DMs 属于基于似然的模型,其模式行为使其易于在建模数据的不可感知细节上花费过多的容量(以及计算资源)。尽管重加权变分目标旨在通过对初始去噪步骤采样不足来解决这一问题,DMs 仍然需要大量的计算,因为训练和评估这样的模型需要在 RGB 图像的高维空间中重复函数评估和梯度计算。

- 例如,训练最强大的 DMs 通常需要数百个 GPU/天,并且在输入空间渲染的噪声版本上重复计算也非常昂贵。在单个 A100 GPU 上生成 50k 样本大约需要 5 天。评估一个已经训练好的模型在时间和内存上也是昂贵的,因为相同的模型架构必须按顺序运行大量的步骤。

提出问题

- 为了提高这种强大模型的可访问性,同时降低其巨大的资源消耗,需要一种降低训练和采样计算复杂度的方法。因此,减少 DM 的计算需求而不影响其性能是提高其可访问性的关键。

解决方法:Departure to Latent Space(脱离并去往潜在空间)

- 与任何基于似然的模型一样,学习大致可以分为两个阶段:第一阶段是感知压缩阶段,它去除了高频细节,但仍然学习到很少的语义变化。在第二阶段,实际的生成模型学习数据的语义和概念组成(语义压缩)。因此,目标是首先找到一个感知上等同,但计算上更合适的空间,在这里训练高分辨率图像合成扩散模型。

方法的优点

- 只需要训练通用自动编码阶段一次,因此可以重用它进行多个 DM 训练或探索可能完全不同的任务。这使得对各种图像到图像和文本到图像任务的大量扩散模型的有效探索成为可能。对于后者,作者设计了一个架构,将 transformer 连接到 DM 的 UNet 主干,并支持任意类型的基于条件的调节机制。

Contributions

- 与纯粹基于 transformer 的方法相比,该方法可以更优雅地扩展到更高维数据,因此可以在压缩级别上工作,并比以前的工作更高效地应用于高分辨率生成。

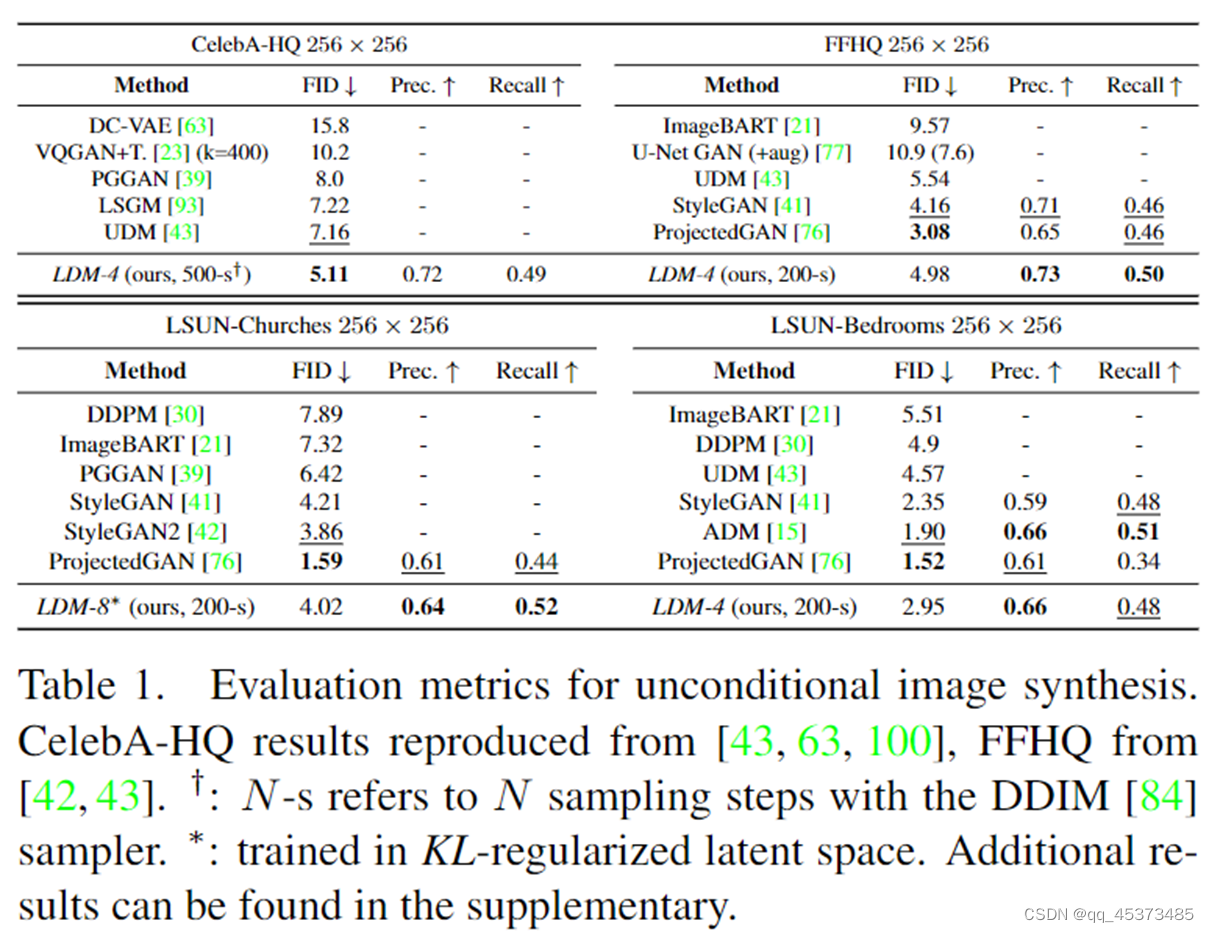

- 在多任务(无条件图像合成、修补、随机超分辨率)和数据集上获得了具有竞争力的性能,同时显著降低了计算成本。与基于像素的扩散方法相比,也显著降低了推理成本。

- 结果表明,与之前的工作相比,这种方法不需要对重构和生成能力进行精确加权。这确保了非常忠实的重建,需要非常少的潜空间正则化。

- 对于超分辨率、修补和语义合成等高密度条件任务,模型可以以卷积的方式应用,渲染出大的、一致的 1024*1024 像素高分图像。

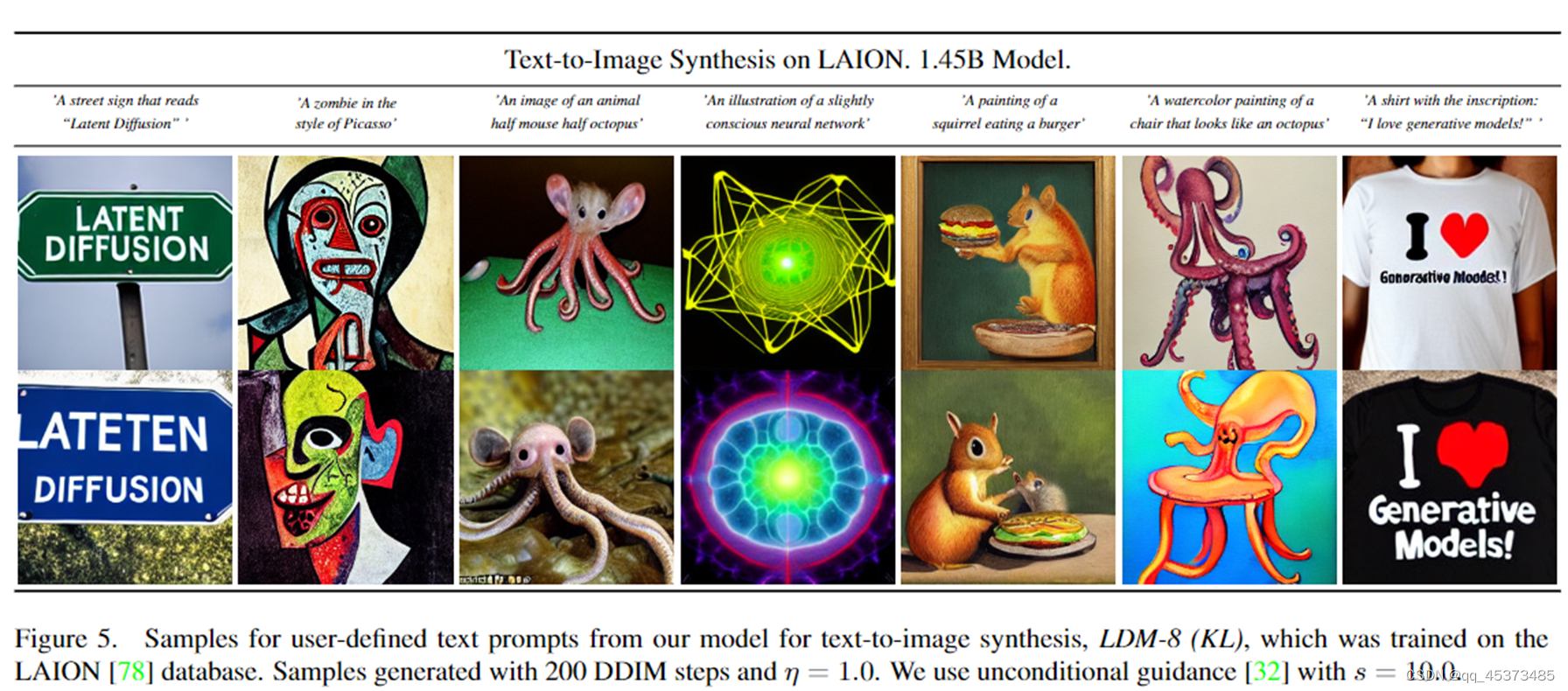

- 此外,作者设计了一个基于交叉注意的通用条件反射机制,使得多模态训练成为可能,并用它来训练类条件模型、文本到图像模型和布局到图像模型。

Related Work

- Generative Models for Image Synthesis

- Diffusion Probabilistic Models (DM)

- Two-Stage Image Synthesis

Generative Models for Image Synthesis

Diffusion Probabilistic Models (DM)

DM 在密度估计和样品质量方面取得了最先进的结果。这些模型的生成能力源于对图像类数据的归纳偏置的自然拟合,当其底层神经骨干作为 UNet 实现时效果尤其突出。最好的综合质量通常是在重新加权目标用于训练时达到的。在这种情况下,DM 对应于一个有损压缩器,并允许用图像质量交换压缩能力。然而,在像素空间中评估和优化这些模型的缺点是推理速度低,训练成本很高。作者用提出的 LDM 解决了这两个缺点,它们工作在一个较低维度的压缩空间上。这使得训练计算成本更低,并加快了推理速度,几乎不降低合成质量。

Two-Stage Image Synthesis

为了缓解单个生成方法的缺点,大量研究通过两阶段方法将不同方法的优点结合成更有效的生成模型。

Method

- Perceptual Image Compression

- Latent Diffusion Models

- Conditioning Mechanisms

Perceptual Image Compression

通过引入压缩和生成学习阶段的显式分离,作者规避了高维像素空间训练的缺陷。为了实现这一目标,使用了一个自编码模型,该模型学习的空间在感知上与图像空间等效,但显著降低了计算复杂度。

这种方法有几个优点:

- 通过离开高维图像空间,得到的 DM 计算效率更高,因为采样是在低维空间上进行的。

- 利用了继承自其 UNet 体系结构的归纳偏差,这使得它们对具有空间结构的数据特别有效,因此减轻了以前方法所要求的压缩级别需求。

- 获得了通用压缩模型,其潜在空间可用于训练多个生成模型,也可用于其他下游应用,如单幅图像 clip 引导的合成。

作者的感知压缩模型基于以前的工作,由一个自动编码器组合训练的感知损失和基于补丁的对手目标组成。这保证了重建被限制在图像流形上,执行局部真实感并避免仅依靠像素空间损失带来的模糊。

为了避免任意高方差的潜在空间,文中使用了两种不同的正则化进行实验:KL-reg 和 VQ-reg。因为后续的 DM 设计用于学习到的潜空间

z = E(x) 的二维结构,所以可以使用相对温和的压缩率并实现非常好的重构。这与之前依赖 1D 顺序对其分布进行自回归建模的工作形成了对比,因此压缩模型更好地保留了输入图像细节。Latent Diffusion Models

通过训练好的由

E 和 D 组成的感知压缩模型,作者进入了一个有效的、低维的潜在空间。在这个空间中,高频率的、不可感知的细节被抽象出来。与高维像素空间相比,该空间更适合基于似然的生成模型,因为它们现在可以关注数据的重要语义位,并且在较低维度、计算效率更高的空间中进行训练。

Experiments

Implementation Details

Conditional Latent Diffusion

Super-Resolution with Latent Diffusion

Limitations & Societal Impact

局限性:虽然与基于像素的方法相比,LDM 显著减少了计算需求,但其顺序采样过程仍比 GANs 慢。此外,当需要高精度时,使用 LDM 是有问题的:尽管在作者的自编码模型中,图像质量损失非常小,但其重建能力可能成为在像素空间中要求细粒度精度任务的瓶颈。超分辨率模型在这方面已经表现出一定局限。

Conclusion

提出了潜在扩散模型,这是一种简单有效的方法,可以显著提高去噪扩散模型的训练效率和采样效率,而不降低其质量。基于这一点和交叉注意调节机制,实验表明,在没有任务特定架构的条件图像合成任务中,与最先进的方法相比可以取得良好结果。